Decision-OS Insights

DoA für KI-Agenten (Delegation of Authority) – Entscheidungsrechte sauber definieren

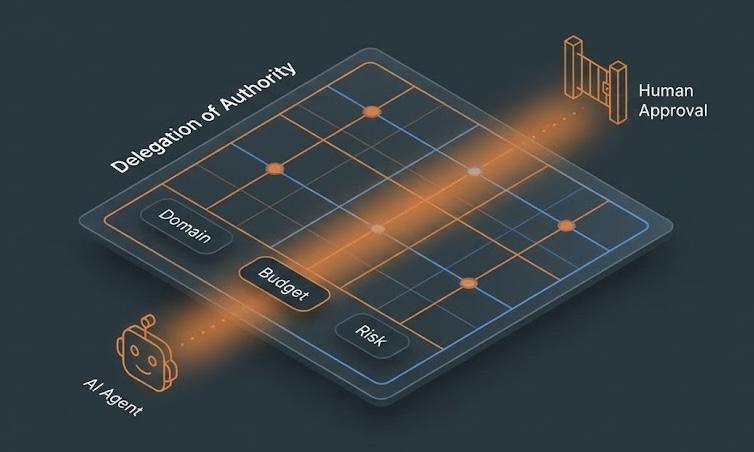

Agentische KI (Agentic AI) entfaltet erst dann Wirkung, wenn klare Entscheidungsrechte gelten. Dieses Playbook zeigt, wie Sie eine Delegation of Authority (DoA) für KI-Agenten definieren: entlang von Domäne, Wertschwellen, Reversibilität (Type 1/2), Stakeholder, Risikoklasse und Forum. Ergebnis: Geschwindigkeit ohne Kontrollverlust – kompatibel mit Ihrem Decision-OS und den Agentic-AI-Guardrails.

Warum DoA für KI-Agenten (Decision Rights) jetzt Pflicht ist

Ohne explizite Entscheidungsrechte bleibt KI entweder Spielerei oder Sicherheitsrisiko. Eine DoA-Struktur legt fest, wer – Mensch oder KI-Agent – was in welchem Rahmen entscheiden darf, wann Human-in-the-Loop (HITL) greift und wo Review & Audit stattfinden. Das reduziert Decision Latency, verhindert Reopens und macht Automatisierung prüfbar.

Die sechs Dimensionen einer belastbaren DoA

1) Domäne (Domain)

Bereiche wie Marketing, Sales, Finance, Ops, HR, Product/Tech. Entscheidungen sind immer domänenspezifisch.

- Beispiel: „Marketing – Kampagnen-Budgetierung unter X €“

2) Betrag/Schwellen (Value Thresholds)

Monetäre Grenzen oder Risiko-Schwellen, z. B. „bis 2.500 € pro Vorgang“ oder „kritische Systeme = HITL“.

3) Reversibilität (Type 1/2)

Type 1 = irreversibel, strategisch; Type 2 = reversibel, operativ. Type-1 braucht HITL & Forum, Type-2 kann KI-autonom sein.

4) Stakeholder (Inform/Consult)

Wer muss informiert oder konsultiert werden – analog zu RACI, aber leichtgewichtig und maschinenlesbar.

5) Risikoklasse (Guardrails)

Low/Medium/High – verknüpft mit Guardrails und HITL-Richtlinien.

6) Forum & Review (Cadence)

Tactical wöchentlich für Type-2; Strategic monatlich/Quartal für Type-1. Reviews mit Log-Pflicht.

Das Minimal-Schema: DoA-Regel als Datensatz

So wird Ihre DoA maschinenlesbar – Basis für Automatisierung, Audit und BI.

rule_id,domain,threshold_eur,decision_type(1|2),risk_class(low|med|high),forum(tactical|strategic|ad-hoc),hitl(true|false),inform[roles],consult[roles],review_after_days,owner_role

rule_id.

Damit sind DoA-Regel, Entscheidung, Review und KPI-Effekte (TtD, Reopen-Rate) verbunden.

Mehr dazu: Decision-Data-Layer.

Template-Beispiele (sofort nutzbar)

Marketing – Budgetfreigabe

- Domäne: Marketing

- Schwelle: ≤ 2.500 € pro Kampagne

- Type: 2 (reversibel)

- Risk: low → HITL: false

- Forum: Tactical (wöchentlich)

- Inform/Consult: Inform Finance, Consult Brand

- Review: 30 Tage

Finance – Zahlungsfreigabe

- Domäne: Finance

- Schwelle: ≤ 1.000 € einmalig

- Type: 2 (reversibel)

- Risk: med → HITL: true

- Forum: Tactical; Escalation: ad-hoc

- Inform/Consult: Inform Requestor, Consult Controller

- Review: 7 Tage

Einführung in 5 Schritten

- Scope & Domänen festlegen – maximal 6 starten (Marketing, Sales, Finance, Ops, HR, Tech).

- Schwellen & Type definieren – €-Grenzen, Type-1/2-Heuristik, Risikoklassen.

- Stakeholder-Regeln vereinfachen – nur „Inform/Consult“, Rollen statt Personen.

- Forums-Routing aktivieren – Tactical für Type-2, Strategic für Type-1, Ad-hoc für Eskalation.

- Decision-Log koppeln – jede Entscheidung mit

rule_id, Review-Pflicht, KPIs messen.

Warum DoA die Brücke zwischen Governance und KI-Autonomie ist

In vielen Unternehmen scheitert die Einführung von Agentic AI (agentische KI) an einem scheinbaren Widerspruch: Entweder blockiert Governance die Geschwindigkeit – oder Autonomie erzeugt Risiko. Eine saubere Delegation of Authority (DoA) löst diesen Widerspruch. Sie definiert die Spielfeldränder, innerhalb derer KI-Agenten zügig entscheiden dürfen, und bestimmt präzise, wann Human-in-the-Loop (HITL) greift. Entscheidend ist die Maschinenlesbarkeit der Regeln: Domäne, Schwellen, Reversibilität (Type 1/2), Risikoklasse, Forum und Stakeholder werden als Datenobjekte geführt und mit dem Decision-Log verknüpft. So entsteht ein Decision-Data-Layer, der Geschwindigkeit messbar macht (TtD, Reopen-Rate) und die Wirkung von Guardrails nachvollziehbar belegt.

Operativ bedeutet das: Type-2-Entscheidungen (reversibel) laufen im Tactical-Forum weitgehend autonom – oft ganz ohne HITL. Type-1-Entscheidungen (irreversibel) werden im Strategic-Forum vorbereitet, protokolliert und mit Review-Termin versehen. Die Kombination aus DoA, Guardrails und Log schafft ein Betriebssystem für Entscheidungen – ein Decision-OS –, das technische und psychologische Reibung zugleich reduziert. Wer schneller werden will, beginnt daher nicht bei Tools, sondern bei Rechten: erst klären, wer entscheidet; dann entscheiden, wie KI unterstützt; und schließlich messen, welche Latenz verschwindet. Für einen kontrollierten Einstieg in die Praxis empfehlen wir die ADIAMO KI-Suite als strukturierte Workshop-Sequenz und die Guardrails als durchsetzbare Leitplanken.

Weiterführende Inhalte

Richtlinien

Human-in-the-Loop (HITL) – Leitplanken & Schwellen

Wann greift HITL, wann Autonomie? So definieren Sie verantwortliche KI-Entscheidungen.

Vorlagen

Agentic-AI-Guardrails – Templates für den Start

Drei einsatzfertige Policy-Muster für Low/Medium/High-Risk inklusive Review-Zyklen.

Programme

ADIAMO KI-Suite – Governance, Readiness, Pilot

Drei 1-Tages-Deep Dives – Governance & Kontrolle, Decision-Log & KPI-Set, Pilot & Umsetzung.

FAQ – DoA für KI-Agenten

Was unterscheidet DoA von RACI (Responsible, Accountable, Consulted, Informed)?

RACI beschreibt Kollaborationsrollen. DoA definiert Entscheidungsrechte – wer darf was entscheiden, unter welchen Schwellen und mit welchen Guardrails.

Wie verknüpfe ich DoA mit Human-in-the-Loop (HITL)?

Über Risikoklassen und Type 1/2. High-Risk und Type-1 erzwingen HITL, Low-Risk/Type-2 erlauben Autonomie.

Was brauche ich als Minimal-Datenmodell?

Eine maschinenlesbare Regel mit domain, threshold_eur, decision_type, risk_class, forum, hitl, inform, consult und review_after_days.

Welche Foren nutze ich für Reviews?

Tactical (wöchentlich) für Type-2; Strategic (monatlich/Quartal) für Type-1; Ad-hoc für Eskalationen.

Wie messe ich den Effekt?

Primär über Time-to-Decision (TtD), Reopen-Rate und Anteil „DRI + Termin“. Ergänzend: Kill-Rate und Meeting-Output-Quote.